Ingeniería de Comandos Prácticos

Practical Command Engineering

Consejos y trucos para un promteo exitoso con LLMs…

Debido a su formato de texto a texto, los modelos de lenguaje grandes (LLMs, por sus siglas en inglés) son capaces de resolver una amplia variedad de tareas con un solo modelo. Esta capacidad se demostró originalmente a través del aprendizaje sin datos y con pocos datos con modelos como GPT-2 y GPT-3 [5, 6]. Sin embargo, cuando se ajustan para alinearse con las preferencias e instrucciones humanas, los LLMs se vuelven aún más convincentes, lo que permite aplicaciones generativas populares como asistentes de codificación, agentes de diálogo para buscar información y experiencias de búsqueda basadas en chat.

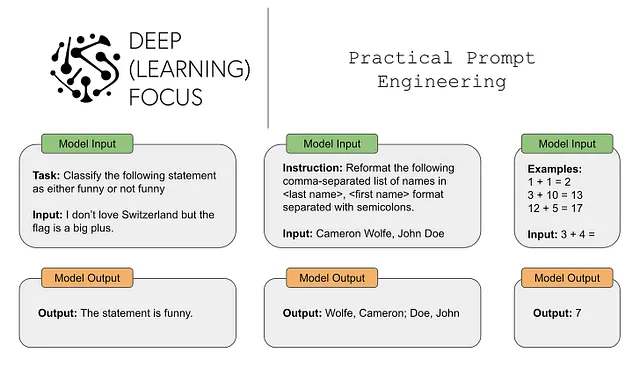

Debido a las aplicaciones que hacen posibles, los LLMs han experimentado un rápido ascenso a la fama tanto en las comunidades de investigación como en la cultura popular. Durante este ascenso, también hemos sido testigos del desarrollo de un nuevo campo complementario: la ingeniería de prompts. A nivel general, los LLMs funcionan tomando texto (es decir, un prompt) como entrada y produciendo una salida textual a partir de la cual podemos extraer algo útil (por ejemplo, una clasificación, una sumarización, una traducción, etc.). La flexibilidad de este enfoque es beneficiosa. Al mismo tiempo, sin embargo, debemos determinar cómo construir correctamente nuestro prompt de entrada para que el LLM tenga la mejor oportunidad de generar la salida deseada.

La ingeniería de prompts es una ciencia empírica que estudia cómo diferentes estrategias de promteo se pueden utilizar para optimizar el rendimiento de los LLMs. Aunque existen diversas aproximaciones, en esta visión general nos enfocaremos en comprender los mecanismos generales del promteo, así como algunas técnicas fundamentales (¡pero increíblemente efectivas!) como el aprendizaje sin datos y el promteo por instrucciones. A lo largo del camino, aprenderemos trucos prácticos y lecciones que se pueden adoptar de inmediato para convertirse en un ingeniero de prompts y un practicante de LLMs más efectivo.

Comprensión de los LLMs. Debido a su enfoque en el promteo, esta visión general no explicará la historia ni los mecanismos de los modelos de lenguaje. Para obtener una mejor comprensión general de los modelos de lenguaje (lo cual es un requisito previo importante para comprender profundamente el promteo), he escrito diversas visones generales que están disponibles. Estas visiones generales se enumeran a continuación (en orden de…)

- Descripción rápida y sencilla de los metadatos de un artículo de investigación

- Investigadores de NYU y Meta AI están mejorando los agentes de conversación social mediante el aprendizaje del diálogo natural entre los usuarios y un modelo implementado, sin necesidad de anotaciones adicionales.

- Un enfoque simple para crear transformadores personalizados utilizando las clases de Scikit-Learn

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- De muchos a pocos Abordando datos de alta dimensionalidad con la reducción de dimensionalidad en el aprendizaje automático

- Mejores herramientas de corrección gramatical de IA 2023

- Artículo de Georgia Tech propone un método de IA para identificar superconductores potenciales más rápido

- LG AI Research Propone QASA Un nuevo conjunto de datos de referencia de IA y un enfoque computacional

- La necesidad de un gradiente de explicabilidad en IA

- Sobrevive al Apocalipsis del Mercado Laboral de IA Guía de Supervivencia – Parte 1

- Los 8 mejores complementos de ChatGPT para 2023 (y cómo usarlos)